কৃত্রিম বুদ্ধিমত্তা নিয়ে গবেষণা চলে আসছে

দীর্ঘদিন থেকেই। তবে সাম্প্রতিক বছরগুলোতে এসে চমকপ্রদ সব সাফল্য মিলতে

শুরু করেছে। এর ফলে কৃত্রিম বুদ্ধিমত্তাসম্পন্ন সব রোবট যেমন তৈরি হচ্ছে,

তেমনি রোবটের কর্মক্ষেত্রকে প্রসারিত করা হচ্ছে নানা দিকে। ঘর-গৃহস্থালী তো

বটেই, এখন শিল্প-কারখানাগুলোতেও রোবটের ব্যবহার শুরু হয়েছে। পশ্চিমা উন্নত

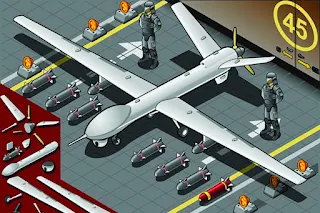

দেশগুলোতে সর্বশেষ সামরিক বাহিনীতেও রোবটের ব্যবহার নিয়ে কাজ শুরু হয়েছে।

এই উদ্দেশ্যে স্বচালিত অস্ত্রশস্ত্র তৈরি নিয়েও গবেষণা চলমান। এরই মধ্যে

এসব স্বচালিত অস্ত্র বা ‘কিলার রোবট’ নিয়ে বিতর্কও উঠেছে বিশ্বজুড়ে। এবারে

শীর্ষস্থানীয় বিজ্ঞানী, গবেষক, প্রযুক্তি ব্যক্তিত্বরা সরাসরি অবস্থান

নিয়েছেন এমন ‘কিলার রোবটে’র বিপক্ষে। বিশ্বখ্যাত বিজ্ঞানী স্টিফেন হকিং,

প্রযুক্তি উদ্যোক্তা ইলন মাস্ক, অ্যাপলের সহ-প্রতিষ্ঠাতা স্টিভ ওজনিয়াক,

এমআইটির অধ্যাপক নোয়াম চমস্কি, গুগলের কৃত্রিম বুদ্ধিমত্তা বিভাগের প্রধান

ডেমিস হাসাবিসের মতো সব ব্যক্তিত্বরা এক খোলা চিঠিতে ‘কিলার রোবট’ বা

স্বচালিত সব অস্ত্রের বিপক্ষে নিজেদের অবস্থানকে স্পষ্ট করে তুলেছেন। তারা

এই চিঠিতে যেকোনো ধরনের অস্ত্রে বা অস্ত্র ব্যবস্থাপনায় কৃত্রিম

বুদ্ধিমত্তার সংযুক্তি একে মানুষের নিয়ন্ত্রণের বাইরে নিয়ে যেতে পারে আশংকা

জানিয়ে তারা একে নিষিদ্ধ করার দাবিও তুলেছেন। চিঠিতে বলা হয়েছে, ‘রসায়ন

বিজ্ঞানী বা জীব বিজ্ঞানীদের যেমন এখন আর রাসায়নিক বা জীব অস্ত্র তৈরির

বিষয়ে কোনো ধরনের আগ্রহ নেই, ঠিক তেমনই কৃত্রিম বুদ্ধিমত্তা খাতের

গবেষক-বিজ্ঞানীরাও অস্ত্রে বা অস্ত্র ব্যবস্থাপনায় কৃত্রিম বুদ্ধিমত্তার

ব্যবহার নিয়ে আগ্রহ বোধ করেন না। এই বিষয়টি নিয়ে গবেষণা হোক, সেটাও তারা

চান না।’ এর কারণ হিসেবে তারা স্বচালিত অস্ত্রকে সমরাস্ত্রের তৃতীয় প্রজন্ম

হিসেবে উল্লেখ করে জানিয়েছেন, গান পাউডার এবং পারমাণবিক অস্ত্রের পর এটি

অস্ত্রের ক্ষেত্রে এক নতুন বৈপ্লবিক ধারণা যা একটা সময়ে গিয়ে মানুষের

বিপক্ষে অবস্থান গ্রহণ করার সক্ষমতা রাখে। তারা লিখেছেন, ‘সর্বশেষ আমরা

বলতে চাই, মানবজাতির ও মানবতার জন্য কৃত্রিম বুদ্ধিমত্তাকে ইতিবাচক ব্যবহার

করার অমিত সম্ভাবনা রয়েছে এবং কৃত্রিম বুদ্ধিমত্তা বিষয়টির উদ্ভবও এই

ধরনের কাজের জন্যই। তাই সমরাস্ত্র খাতে কৃত্রিম বুদ্ধিমত্তার ব্যবহারের

ধারণাটি অত্যন্ত বাজে এবং সব ধরনের স্বচালিত অস্ত্র তৈরির ওপর নিষেধাজ্ঞা

জারির মাধ্যমেই এই ধারণাকে প্রতিহত করা উচিত।’ ফিউচার অব লাইফ ওয়েবসাইটে

প্রকাশিত এই খোলা চিঠি পাওয়া যাবে http://goo.gl/1ck2ZS লিংকে। শুধু এই

খোলা চিঠি লিখেই ক্ষান্ত হননি সংশ্লিষ্টরা। বিভিন্ন ওয়েবসাইটে তারা এই

সংশ্লিষ্ট বিভিন্ন প্রশ্নের জবাব পাওয়ারও সুযোগ রেখেছেন। এর মধ্যেই স্টিফেন

হকিং রেড্ডিট ওয়েবসাইটে ‘আস্ক মি অ্যানিথিং’ নামের এক বিশেষ প্রশ্নোত্তর

পর্বেও অংশ নিয়েছেন। এই সেশনে এক প্রশ্নের জবাবে তিনি স্পষ্ট করে বলেন,

‘ধীরগতির জীব বিবর্তনের ধারায় সীমাবদ্ধ মানবজাতি কৃত্রিম বুদ্ধিমত্তার সাথে

পেরে উঠবে না এবং কৃত্রিম বুদ্ধিমত্তা মানুষকে

All Right Reserved Copyright ©Seba Hot News

#buttons=(Ok, Go it!) #days=(20)

Our website uses cookies to enhance your experience. Know about Cookies

Ok, Go it!